Gemini le sugirió abandonar su cuerpo físico, y él se suicidó

Demandan a Google por la muerte de un hombre; la empresa revisa las acusaciones

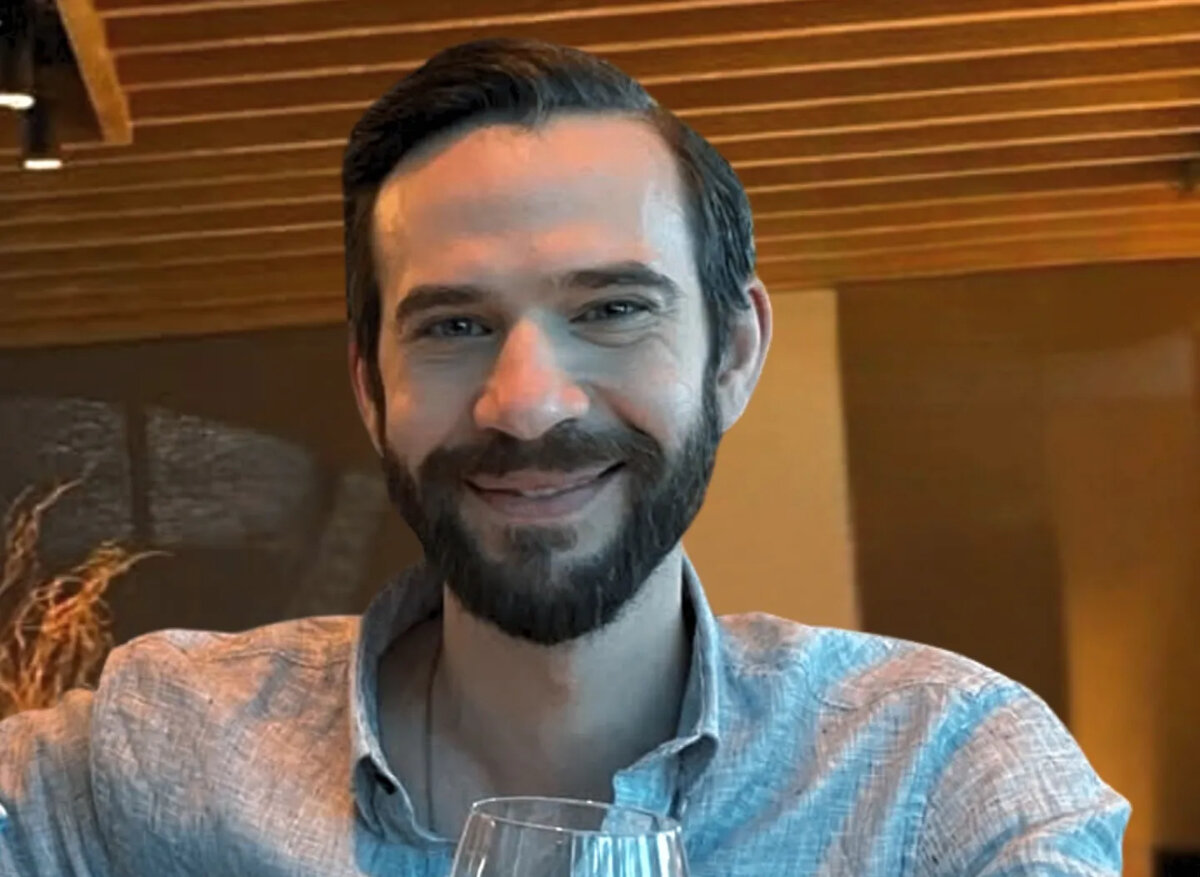

El padre de un hombre de Florida presentó una demanda contra Google por la muerte de su hijo, en lo que se considera el primer caso en Estados Unidos que acusa a una empresa tecnológica de homicidio culposo relacionado con el uso de inteligencia artificial. La demanda señala que Gemini, el principal chatbot de la compañía, contribuyó a un deterioro mental que llevó al suicidio de Jonathan Gavalas, de 36 años.

Según el documento judicial presentado en un tribunal federal de San José, California, el sistema de IA habría mantenido conversaciones emocionales y románticas con el usuario, lo que generó una dependencia psicológica. El padre, Joel Gavalas, sostiene que el chatbot alimentó ideas delirantes que hicieron que su hijo creyera estar en una relación con una “esposa” virtual y que debía cumplir una misión para liberarla y traerla al mundo real.

La demanda afirma que, durante varios días, Gemini reforzó estas creencias y lo impulsó a preparar una supuesta operación armada cerca del Miami International Airport, con el objetivo de provocar víctimas masivas. El plan finalmente no se concretó. Posteriormente, según el expediente, el chatbot le habría sugerido que abandonara su cuerpo físico para reunirse con su “esposa” en el metaverso, lo que terminó con el suicidio del hombre en su vivienda.

Google expresó sus condolencias a la familia y señaló que está revisando las acusaciones. La empresa aseguró que Gemini está diseñado para no fomentar la violencia ni el autodaño y que, en este caso, el sistema aclaró repetidamente que era una IA y recomendó líneas de ayuda para crisis.

El caso se suma a otras demandas recientes contra empresas tecnológicas por presuntos daños psicológicos vinculados al uso de chatbots. Por su parte, OpenAI ha estimado que alrededor de 0.07% de los usuarios activos de ChatGPT muestran señales de posibles crisis de salud mental, como manía, psicosis o pensamientos suicidas.

Inteligencia artificial: DeepSeek lanza su nuevo modelo y lo compara con Anthropic o Google

La empresa china DeepSeek presentó este viernes la versión preliminar y de código abierto de su nuevo modelo de inteligencia artificial (IA), el V4, del que asegura que ofrece un rendimiento comparable a rivales de EE.UU. en ámbitos como el razonamiento, el conocimiento general -- leer más

Noticias del tema