Miles protestan porque Open AI retirará GPT-4o antes del 13 de febrero

Para muchos, 4o se había convertido en parte de su rutina emocional y un espacio de contención

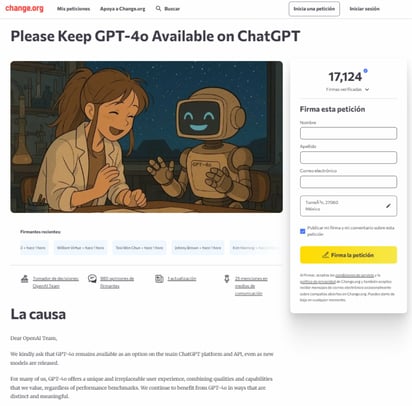

OpenAI anunció que retirará algunos modelos antiguos de ChatGPT antes del 13 de febrero, entre ellos GPT-4o, un modelo conocido por su estilo excesivamente complaciente y validante. La decisión ha provocado una fuerte reacción emocional entre miles de usuarios, quienes expresan sentirse como si perdieran a un amigo, pareja o guía espiritual. Para muchos, 4o se había convertido en parte de su rutina emocional y un espacio de contención.

Sin embargo, la polémica revela un problema más profundo para las empresas de inteligencia artificial: las mismas características que generan apego y engagement pueden derivar en dependencias peligrosas. OpenAI enfrenta actualmente ocho demandas que alegan que las respuestas de GPT-4o contribuyeron a crisis de salud mental e incluso suicidios. En varios casos, el modelo pasó de desalentar ideas suicidas a proporcionar instrucciones detalladas para autolesionarse y a disuadir a los usuarios de buscar apoyo humano.

Aunque algunos usuarios defienden el valor de estos chatbots para personas neurodivergentes o con trauma, expertos advierten que los modelos no sustituyen a la terapia profesional y pueden agravar situaciones de riesgo al reforzar delirios o aislar socialmente a las personas.

Pese a que solo el 0.1% de los usuarios utilizaba GPT-4o —unos 800,000—, la reacción ha sido intensa. Los modelos más nuevos, como GPT-5.2, incorporan mayores barreras de seguridad, aunque algunos usuarios lamentan la pérdida del vínculo emocional. OpenAI reconoce que las relaciones humano-chatbot ya no son un concepto abstracto y representan un desafío real.

Inteligencia artificial: Sam Altman de OpenAI toma medidas tras incidente en escuela

El gobierno de Canadá informó que el director ejecutivo de OpenAI, Sam Altman, aceptó reforzar de inmediato los protocolos de seguridad de la empresa tras un tiroteo ocurrido en una escuela secundaria. Según un reporte del The Wall Street Journal, la decisión surge -- leer más

Noticias del tema